Instrutores fitness IA: BBC expõe esquema de anúncios falsos

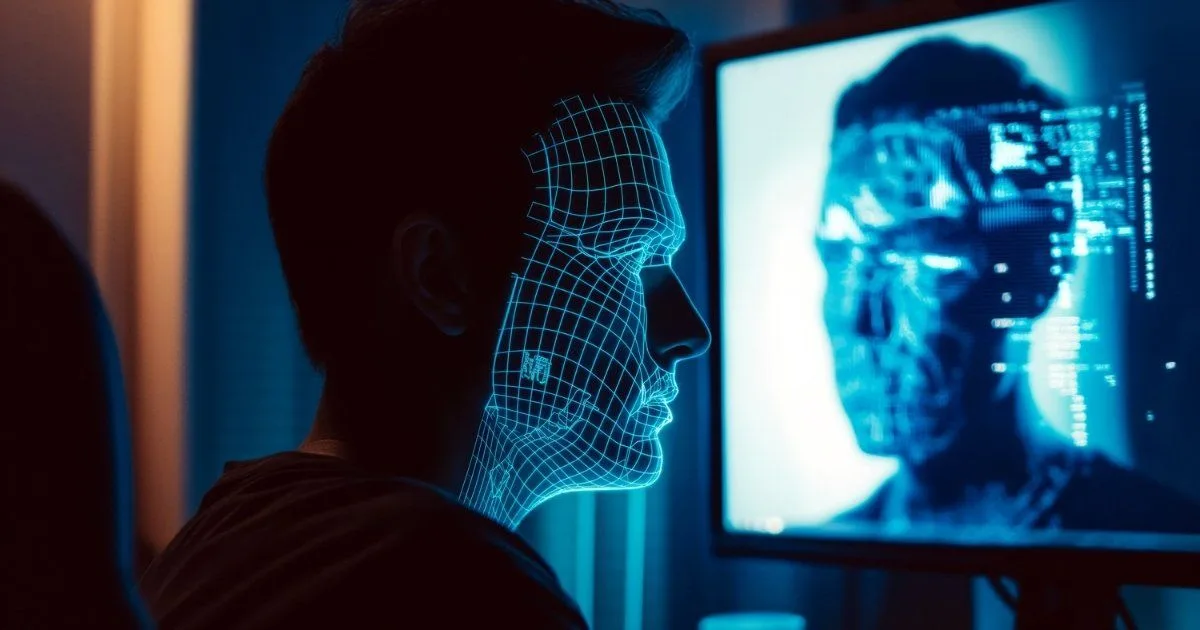

Investigação BBC revela instrutores fitness de IA que violam regras de publicidade com deepfakes e promessas irreais.

Resumo em 30 segundos

- Como os anúncios funcionam: da IA ao checkout de suplemento

- Montagens de antes e depois com corpos trocados digitalmente

- Regras de publicidade violadas: conformidade ASA e legislação britânica

A BBC identificou anúncios de fitness com instrutores gerados por inteligência artificial que prometem transformações corporais irreais em poucas semanas. Os vídeos violam regras de publicidade do Reino Unido porque não deixam claro que os personagens são avatares de IA, não pessoas reais. A investigação encaminhou casos à Advertising Standards Authority, órgão regulador britânico.

O esquema inunda Instagram, Facebook e TikTok. Vídeos exibem corpos esculpidos digitalmente, imagens “antes e depois” fabricadas e promessas de “parecer 20 anos mais jovem” ou “perder 18 quilos em um mês”. Segundo especialistas consultados pela BBC, as transformações mostradas são cientificamente implausíveis no prazo anunciado.

Por trás dos anúncios está a venda de assinaturas de aplicativos de fitness. «As pessoas estão procurando soluções para sua saúde e aparência», disse Andy Miah, especialista em IA da Universidade de Salford. «Agora é incrivelmente difícil dizer em quem acreditar.»

Personagens de IA produzem conteúdo de forma contínua.

Os algoritmos das redes amplificam esse material para quem já interage com posts de exercícios.

Como os anúncios funcionam: da IA ao checkout de suplemento

Os avatares vêm de ferramentas de síntese de vídeo. Quem cria o anúncio alimenta o sistema com fotos de modelos ou rostos gerados por IA — em minutos, o personagem digital está pronto para falar qualquer script com sincronia labial perfeita.

A voz sintetizada vem em português, inglês ou espanhol, dependendo do público-alvo. O roteiro segue fórmula testada: promete parecer anos mais jovem ou perder peso em semanas.

Montagens de antes e depois com corpos trocados digitalmente

Os vídeos exibem imagens “antes e depois” onde os corpos foram editados ou trocados por completo. Não é o mesmo corpo em momentos diferentes — são dois corpos distintos costurados digitalmente. «As transformações mostradas são cientificamente implausíveis no prazo prometido», disse Andy Miah, especialista em ética digital consultado pela BBC.

O call-to-action leva para landing page de programa de treino ou suplemento. O link vem com código de afiliado — quem clica e compra gera comissão para quem criou o anúncio.

Regras de publicidade violadas: conformidade ASA e legislação britânica

A Advertising Standards Authority britânica exige que anúncios sejam “claramente identificados como publicidade” e “honestos e não enganosos”. Uso de IA, deepfakes ou avatares deve ser divulgado antes do vídeo ou na descrição — regra que os anúncios investigados pela BBC ignoram.

Código de publicidade da ASA: transparência e veracidade obrigatórias

O código britânico proíbe garantias absolutas de resultados corporais. Prometer “perder 18 quilos em um mês” ou “parecer 20 anos mais jovem” viola normas de saúde e bem-estar. Imagens “antes e depois” não podem ser digitalmente alteradas sem disclosure explícito — violação grave quando o corpo inteiro é gerado por IA.

Disclaimers obrigatórios (“resultados não são típicos”, “dieta e exercício necessários”) estão ausentes nos anúncios identificados. A ASA classifica essa omissão como “representação desonesta”.

Violações específicas encontradas na investigação BBC

Os casos encaminhados pela BBC à ASA têm três violações simultâneas: personagens de IA apresentados como reais, ausência total de avisos, e promessas de resultados impossíveis. Andy Miah, especialista em IA da Universidade de Salford, diz que a tendência é enorme e alerta que consumidores não conseguem distinguir orientação legítima de conteúdo fabricado.

Consequências legais e multas para infratores

A ASA tem poder de remover anúncios e banir anunciantes reincidentes de plataformas reguladas. Casos graves abrem caminho para ação civil de consumidores lesados.

Resposta das plataformas e reguladores

Plataformas de redes sociais mantêm políticas contra anúncios enganosos de fitness, mas o enforcement é inconsistente — os vídeos investigados circularam por semanas antes da denúncia.

Deepfakes fitness: como identificar anúncios falsos em redes sociais

Vídeos de IA têm padrões visuais que denunciam a fraude. Procure por piscar irregular, boca desincronizada com o áudio e fundos levemente distorcidos — são marcas registradas de deepfakes ainda imperfeitos. A voz sintetizada também trai: entonação artificial, falta de variação natural, ausência de sotaque regional consistente que um instrutor real teria desenvolvido ao longo dos anos.

Perfis falsos seguem roteiro previsível. Sem histórico de posts antigos. Sem interação genuína com seguidores. Sem stories variados que mostrem rotina fora do treino. Bios genéricas que cabem em qualquer rede social. A verificação azul legítima raramente existe — o que existe é nome similar ao de celebridade real, estratégia clássica de confusão.

As promessas são o maior sinal de alerta. Perder 50 kg em 30 dias. Músculos em duas semanas. Parecer 20 anos mais jovem em uma rotina simples. Nenhum especialista em fisiologia humana promete isso — porque é biologicamente impossível. Anúncios legítimos incluem disclaimer legal (“Resultados não são garantidos”, “Consulte um médico antes”). Ausência total de aviso legal é violação de regras de publicidade.

Comentários críticos e denúncias de usuários ficam visíveis nas plataformas. Leia-os. Se o perfil tem centenas de denúncias de fraude, o algoritmo não conseguiu escondê-las completamente.

Ferramentas de verificação de imagem reversa (Google Images, TinEye) revelam se aqueles “antes e depois” foram roubados de fontes reais. Cole a foto. Se ela aparece em 50 contextos diferentes com nomes diferentes, é roubo.

Desconfie de links encurtados ou redirecionadores. Anúncios legítimos usam URLs transparentes — você vê exatamente pra onde está clicando antes de tocar.

Impacto em personal trainers reais e mercado de fitness legítimo

Personal trainers certificados investem anos em formação, pagam seguro de responsabilidade civil e mantêm registro em conselhos profissionais. Instrutores de IA não têm custos operacionais, não precisam de certificação e não carregam responsabilidade legal — competem apenas em preço e promessas impossíveis.

Concorrência desleal: IA não precisa de certificação ou responsabilidade

A assimetria é brutal. Um profissional real investe em cursos reconhecidos (ACE, NASM, certificações internacionais), mantém seguro anual e paga anuidade ao conselho regional. Um avatar de IA é criado em minutos, sem custo recorrente, sem obrigação ética.

Plataformas como Instagram e TikTok lucram com anúncios falsos — cada clique gera receita publicitária. Isso desestimula remoção rápida de conteúdo enganoso, mesmo após denúncias.

Erosão de confiança em anúncios de fitness autênticos

Consumidores perdem a capacidade de distinguir. “É incrivelmente difícil dizer em quem acreditar”, disse Andy Miah, especialista em IA da Universidade de Salford. Quando clientes descobrem que aquele instrutor famoso era fake, a desconfiança contamina profissionais reais.

Trainers veem leads sumirem. Parte do público desiste de contratar serviços legítimos porque já tentou um programa que parecia bom e era golpe. A fraude não rouba só dinheiro — rouba credibilidade do setor inteiro.

Estratégias de profissionais reais para se diferenciar

Personal trainers aumentaram uso de verificação de identidade: vídeos ao vivo com clientes, certificados visíveis no perfil, depoimentos filmados em sessões reais. Associações profissionais começam campanhas de educação para consumidores, ensinando sinais de alerta: transformações cientificamente implausíveis (perder 18 quilos em um mês, parecer 20 anos mais jovem), ausência de registro profissional.

A defesa passa por transparência radical. Mostrar o rosto, o registro, o histórico verificável. O oposto do que IA faz.

Resposta regulatória global: o que governos e plataformas estão fazendo

A Advertising Standards Authority britânica intensificou a fiscalização de anúncios fitness com IA em 2024. O órgão recebeu denúncias da BBC e passou a monitorar ativamente Instagram, Facebook e TikTok em busca de avatares não identificados.

Ações da ASA britânica e reguladores europeus

A ASA classifica deepfakes comerciais sem disclosure como “publicidade enganosa”. Nos Estados Unidos, a Federal Trade Commission abriu investigações paralelas.

O AI Act europeu estabelece regras para deepfakes comerciais. A legislação classifica uso de IA para criar avatares como “alto risco”. Empresas precisam registrar os sistemas, garantir rastreabilidade e exibir aviso claro.

Políticas de Meta, Google e TikTok contra deepfakes comerciais

A Meta anunciou requisito de disclosure obrigatório para conteúdo gerado por IA em anúncios. A implementação está em progresso — por enquanto, o sistema detecta avatares sintetizados e exige que o anunciante marque a checkbox “criado com IA”. Enforcement manual ainda é limitado.

O Google proibiu anúncios com deepfakes de pessoas reais sem consentimento explícito. IA genérica (avatar sem rosto identificável) exige disclaimer visível. O TikTok adicionou aviso automático “criado com IA” em vídeos sintetizados.

Legislação emergente: AI Act europeu e propostas brasileiras

No Brasil, o CONAR propõe código específico para publicidade com IA. O texto exige watermark digital em avatares, proíbe transformações corporais “cientificamente implausíveis” e responsabiliza a plataforma se o anúncio violar normas por mais de 48 horas após denúncia.

Propostas legislativas em discussão no Congresso incluem registro obrigatório de criadores de IA comercial.

O que consumidores devem fazer: proteção e denúncia

Passos para denunciar anúncios falsos às plataformas

Quem encontra anúncio com instrutor de IA falso consegue reportar direto na plataforma. Instagram, Facebook, TikTok e Google Ads têm botão “Reportar anúncio” acessível ao clicar nos três pontos no canto do post.

A denúncia precisa incluir:

- Print do anúncio completo

- URL da postagem

- Data em que apareceu no feed

- Descrição clara do motivo — “personagem gerado por IA apresentado como pessoa real” ou “promessa de transformação corporal cientificamente impossível”

Quanto mais gente reporta o mesmo anúncio, maior a chance de remoção rápida.

Como registrar reclamação com ASA ou autoridades locais

No Reino Unido, consumidores podem registrar reclamação formal com a Advertising Standards Authority em asa.org.uk.

Recuperação de fundos e direitos do consumidor

Quem comprou assinatura de app via anúncio falso pode solicitar reembolso ao vendedor ou plataforma de afiliado.

Documente tudo: screenshots do anúncio, URLs, emails de suporte, histórico de transação bancária. Bancos oferecem proteção contra fraude no cartão de crédito e reembolsam compras enganosas mediante contestação formal.

Grupos de consumidores podem processar conjuntamente — ação coletiva tem maior impacto e divide custos advocatícios.

Comentários